| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- 런처

- #카카오게임

- #라인

- #kakotalk

- #카톡

- 불법

- 티스토리

- 통합

- 돈미쨩

- 미호유

- 호요버스

- #이모티콘

- 원신

- 붕괴

- #kakao

- 이사

- #카카오

- 옮기기

- 스타레일

- #line

- #카카오톡

- 방법

- 돛거

- 카카오

- 네이버

- 류웨이

- #InnerTune #유튜브 #리벤스드 #REVANCED #광고 #제거 #제거프로그램 #YOUTUBE #MICROG #최신 #업데이트 #다운 #다운로드 #다운하기 #크랙 #프리미엄 #뮤직

- honkai

- #카카오프렌즈

- 이사하기

- Today

- Total

로유에스의 개발 회피 블로그

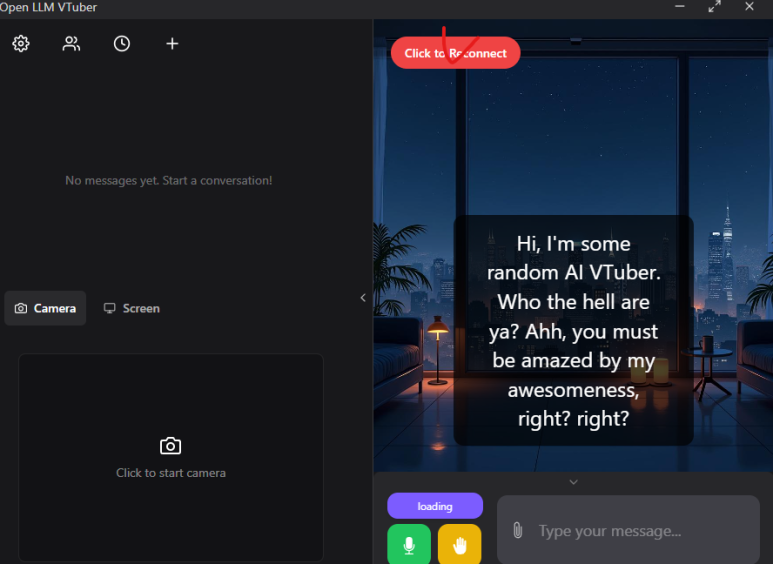

AI를 이용해서 실시간 화면 보면서 AI 여자친구와 이야기하기 본문

https://blog.naver.com/rkdrlgh22/223812926698

AI를 이용해서 실시간 화면 보면서 AI 여자친구와 이야기하기

사용한 레포지드는 https://github.com/Open-LLM-VTuber/Open-LLM-VTuber 는 이게 만들어진지 ...

blog.naver.com

사용한 레포지드는

https://github.com/Open-LLM-VTuber/Open-LLM-VTuber

GitHub - Open-LLM-VTuber/Open-LLM-VTuber: Talk to any LLM with hands-free voice interaction, voice interruption, and Live2D taki

Talk to any LLM with hands-free voice interaction, voice interruption, and Live2D taking face running locally across platforms - Open-LLM-VTuber/Open-LLM-VTuber

github.com

는 이게 만들어진지 별로 안되서 영어와 중국어만 됨

그래서 일단 3줄요약하면

짱/ 영어 안되면 개쓸모 없음

그냥 재미니쓰셈

심지어 이거 가이드도 개판이라서 가이드 영상이 1개임

【【开源 Live2D 虚拟女友】Open-LLM-VTuber v1.1.0 版本安装教学】 https://www.bilibili.com/video/BV1tnPMeKEGx/?share_source=copy_web&vd_source=fea6db66faa1f785cc75dae0fcfdb3e1

해보고싶은 사람들을 위한 요약해줌

그래서 setup이랑

en.zip받아야함

이건 사용 설명서임

1.Install relevant software:Project compression package and installation package、Python 3.12 (recommended)、cuda/cudnn(the newest)、

ollama(the newest)/Apply for Zhipu API(to use glm-4v-flash)、VPN(maybe)

2.set conf.yaml(ASR model,LLM, Live2d model, TTS model, personality description)

3.set model_dict.json(Index the local Live2d model and change the initial size and position of the model)

4.Switch to the table pet mode

5.Customize GPT timbre model

reference

(1)instructions for the configuration section:

winget install --id=astral-sh.uv -e

winget install ffmpeg

uv sync

uv run run_server.py

(2)customize GPT timbre model part:

python api_v2.py -a 0.0.0.0

runtime\python.exe api_v2.py

http://127.0.0.1:9880/set_gpt_weights?weights_path=D:\Open-LLM-VTuber\GPT-SoVITS-v2-240821\GPT_weights_v2\ganyu-e10.ckpt

http://127.0.0.1:9880/set_sovits_weights?weights_path=D:\Open-LLM-VTuber\GPT-SoVITS-v2-240821\SoVITS_weights_v2\ganyu_e10_s170.pth

일단 번역하면

1번에잇는거 필요한거 전부 설치

2번 conf.yaml (서버폴더에 있음) character_config: 에는 live2d를 설정하는거임

이거는 persona_prompt: | 페르소나 프롬을 설정한는거임

마지막으로 에이전트 설정 agent_config: 이거는 api 키를 불러오는거임

로컬로 돌릴꺼면 영상에있는 Ollama 라는 거 써서 로컬로 돌리는거임

model_dict.json로 live2d 다시 정해주기

이제 다하면 Open-LLM-VTuber 서버폴더에서

winget install --id=astral-sh.uv -e

winget install ffmpeg

uv sync

uv run run_server.py

이거 순서대로 다 치면됨

그러고 open-llm-vtuber-electron 에 있는 open-llm-vtuber-electron.exe 의 프로그램을 열기

마지막으로 Click to Reconnect 누르면

실시간 화면 공유나 카메라를 킬려면 왼쪽하단에있는 거 누르면됨

음성이 내마음에 안들면 SO-vITS V3 버전이용해서 api키고 conf.yaml (서버폴더에 있음) 에 gpt_sovits_tts: 있는 부분을 영상에있는 거처럼 설정해서 넣어주면됨

결론은 짱77H/ 영어만 지원되서 한국어,일본어는 추후에 나올꺼를 준비하면됨